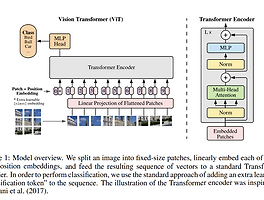

[AI 논문] AN IMAGE IS WORTH 16X16 WORDS:TRANSFORMERS FOR IMAGE RECOGNITION AT SCALE

Transformer는 본래 NLP 쪽에서 주로 활용되었다면, 이를 이미지에도 적용시키고자 나온 개념이 바로 ViT(Vision Transformer)이다. 오늘은 ViT를 다루는 논문, 'AN IMAGE IS WORTH 16X16 WORDS: TRANSFORMERS FOR IMAGE RECOGNITION AT SCALE'에 대해 공부해보겠다. 출처- Dosovitskiy, A., Beyer, L., Kolesnikov, A., Weissenborn, D., Zhai, X., Unterthiner, T., Dehghani, M., Minderer, M., Heigold, G., Gelly, S., Uszkoreit, J., & Houlsby, N. (2021). An image is worth 16x16..

[AI 논문] AN IMAGE IS WORTH 16X16 WORDS:TRANSFORMERS FOR IMAGE RECOGNITION AT SCALE

Transformer는 본래 NLP 쪽에서 주로 활용되었다면, 이를 이미지에도 적용시키고자 나온 개념이 바로 ViT(Vision Transformer)이다. 오늘은 ViT를 다루는 논문, 'AN IMAGE IS WORTH 16X16 WORDS: TRANSFORMERS FOR IMAGE RECOGNITION AT SCALE'에 대해 공부해보겠다. 출처- Dosovitskiy, A., Beyer, L., Kolesnikov, A., Weissenborn, D., Zhai, X., Unterthiner, T., Dehghani, M., Minderer, M., Heigold, G., Gelly, S., Uszkoreit, J., & Houlsby, N. (2021). An image is worth 16x16..

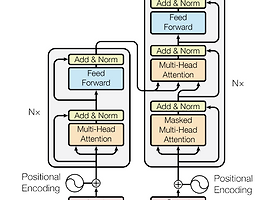

[AI 논문] Attention Is All You Need (2017)

이번 시간에는 레전드 논문 'Attention Is All You Need'를 공부해보겠다.확실히 공부한 걸 블로그로 작성하는 일은 시간은 걸리더라도 long-term memory에 각인되는 것 같다. 공부한 흔적 그 이상의 가치를 가지는 것 같아서 앞으로도 귀찮더라도 꾸준히 포스팅을 해야겠다. 출처- Vaswani, A., Shazeer, N., Parmar, N., Uszkoreit, J., Jones, L., Gomez, A. N., Kaiser, Ł., & Polosukhin, I. (2017). Attention is all you need. Advances in Neural Information Processing Systems, 30, 5998-6008.- Umar Jamil Youtube:..

[AI 논문] Attention Is All You Need (2017)

이번 시간에는 레전드 논문 'Attention Is All You Need'를 공부해보겠다.확실히 공부한 걸 블로그로 작성하는 일은 시간은 걸리더라도 long-term memory에 각인되는 것 같다. 공부한 흔적 그 이상의 가치를 가지는 것 같아서 앞으로도 귀찮더라도 꾸준히 포스팅을 해야겠다. 출처- Vaswani, A., Shazeer, N., Parmar, N., Uszkoreit, J., Jones, L., Gomez, A. N., Kaiser, Ł., & Polosukhin, I. (2017). Attention is all you need. Advances in Neural Information Processing Systems, 30, 5998-6008.- Umar Jamil Youtube:..